как быстро найти их и удалить, основные способы и методы — руководство от SEO.RU

Почему дубли страниц — это плохо?

Дубли — это страницы с одинаковым содержимым, т.е. они дублируют друг друга.

Причины, по которым страницы дублируются, могут быть разными:

- автоматическая генерация;

- ошибки в структуре сайта;

- некорректная разбивка одного кластера на две страницы и другие.

Дубли страниц — это плохо для продвижения и раскрутки сайта, даже несмотря на то, что они могут появляться по естественным причинам. Дело в том, что поисковые роботы хуже ранжируют страницы, контент которых мало чем отличается от других страниц. И чем больше таких страниц, тем больше сигналов поисковым ботам, что это сайт не достоин быть в топе выдачи.

Что происходит с сайтом, у которого есть дубликаты страниц?

- Снижается его релевантность.

- Снижается процент уникальности текстового контента. Из-за этого понизится уникальность всего сайта.

- Снижается вес URL-адресов сайта. По каждому запросу в выдачу поиска попадает только одна страница, а если таких одинаковых страниц несколько, все теряют в весе.

- Увеличивается время на индексацию. Чем больше страниц, тем больше времени нужно боту, чтобы индексировать ваш сайт. Для крупных сайтов проблемы с индексацией могут сильно сказаться на трафике из поиска.

- Бан от поисковых систем. Можно вообще вылететь из выдачи на неопределенный срок.

В общем, становится понятно, что дубли никому не нужны. Давайте разбираться, как найти и обезвредить дублирующиеся страницы на сайте.

Как найти дубли страниц?

Кирилл Бузаков,

SEO-оптимизатор компании SEO.RU:

«Когда мы получаем в работу сайт, мы проверяем его на наличие дублей страниц, отдающих код 200. Разберем, какие это могут быть дубли.

Возможные типы дублей страниц на сайте

-

Дубли страниц с протоколами http и https.

Например: https://site.ru и http://site.ru

-

Дубли с www и без.

-

Дубли со слешем на конце URL и без.

Например: https://site.ru/example/ и https://site.ru/example

-

Дубли с множественными слешами в середине либо в конце URL.

Например: https://site.ru/////////, https://site.ru/////////example/

-

Прописные и строчные буквы на различных уровнях вложенности в URL.

Например:

-

Дубли с добавлением на конце URL:

- index.php;

- home.php;

- index.html;

- home.html;

- index.htm;

- home.htm.

Например: https://site.ru/example/ и https://site.ru/example/index.html

-

Дубли с добавлением произвольных символов либо в качестве нового уровня вложенности (в конце или середине URL), либо в существующие уровни вложенности.

-

Добавление произвольных цифр в конце URL в качестве нового уровня вложенности.

Например: https://site.ru/example/ и https://site.ru/example/32425/

-

Дубли с добавлением «звездочки» в конце URL.

Например: https://site.ru/example/ и https://site.ru/example/*

-

Дубли с заменой дефиса на нижнее подчеркивание или наоборот.

Например: https://site.ru/defis-ili-nizhnee-podchyorkivanie/ и https://site.ru/defis_ili_nizhnee_podchyorkivanie/

-

Дубли с некорректно указанными уровнями вложенности.

Например: https://site.ru/category/example/ и https://site.ru/example/category/

-

Дубли с отсутствующими уровнями вложенности.

Например: https://site.ru/category/example/ и https://site.ru/example/

Как обнаружить дубли страниц?

Поиск дублей страниц можно произвести разными способами. Если вы хотите собрать все-все дубли и ничего не упустить, лучше использовать все нижеперечисленные сервисы совместно. Но для поиска основных достаточно какого-то одного инструмента, выбирайте, какой вам ближе и удобнее.

-

Парсинг сайта в специализированной программе

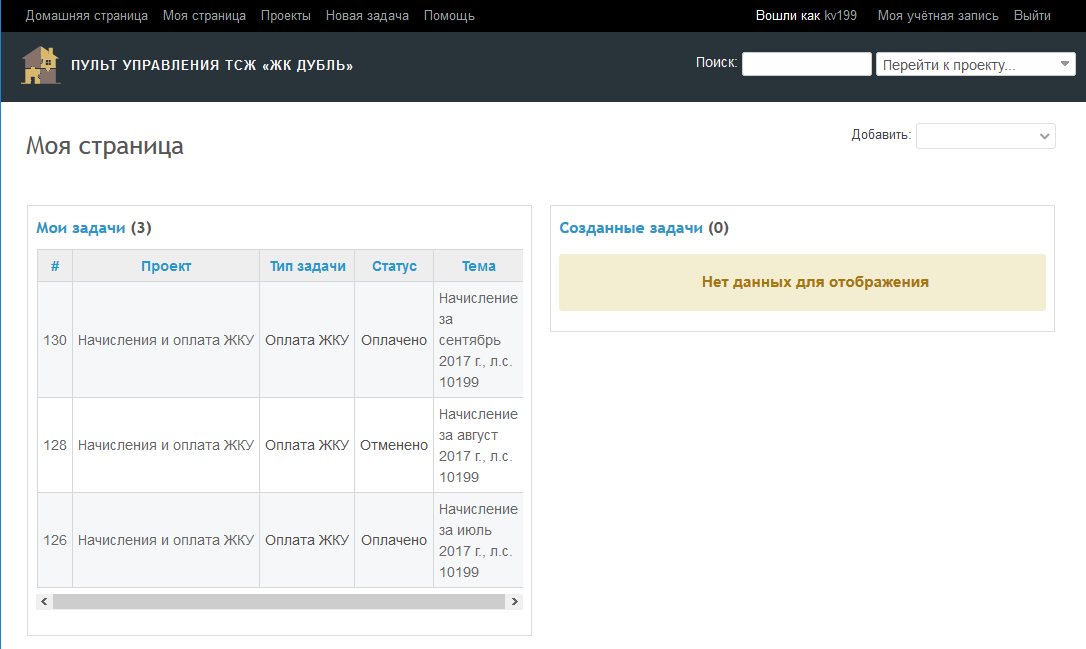

Для поиска дубликатов подходит программа Screaming Frog SEO Spider. Запускаем сканирование, а после него проверяем дубли в директории URL → Duplicate:

Кроме того, в директории Protocol → HTTP проверяем страницы с протоколом http — есть ли среди них те, у которых Status Code равен 200:

-

Онлайн-сервисы.

Первый, подходящий нашим целям сервис, — это ApollonGuru.

- Выбираем 5-7 типовых страниц сайта. Например, набор может быть таким: главная, разводящая, карточка товара/страница услуги, статья в блоге, а также другие важные страницы в зависимости от типа сайта.

- Вносим их в поле «Поиск дублей страниц» и нажимаем кнопку «Отправить»:

- Дубли с 200 кодом ответа сервера (смотрим столбец «Код ответа сервера») берем в работу:

Кроме того, необходимо проверять, что с дублей настроены прямые 301 редиректы на основные версии этих же страниц.

Также проверка дублей сайта возможна онлайн-сервисом Check Your Redirects and Statuscode, но он подходит только в том случае, если нужно проанализировать один URL-адрес:

-

Панели веб-мастеров Яндекса и Google.

Найти дублирующиеся страницы можно с помощью собственных инструментов поисковиков — Яндекс.Вебмастера и Google Search Console.

В Яндекс.Вебмастере анализируем раздел «Индексирование», далее — «Страницы в поиске»:

Там можно увидеть текущую индексацию сайта и искомые дубли страниц:

В Search Console анализируем раздел «Покрытие», а именно пункт с исключенными из индекса страницами:

Собираем все дубли в одну таблицу или документ. Затем отправляем их в работу программисту:

Старайтесь подробнее объяснить программисту задачу, так как адресов может быть много».

Как убрать дубли страниц на сайте?

Евгений Костырев,

веб-программист компании SEO.RU:

«С дублирующимися страницами бороться можно разными способами. Если есть возможность, стоит использовать ручной метод. Но такая возможность есть не всегда, потому что здесь нужны серьезные навыки программирования: как минимум, нужно хорошо разбираться в особенностях CMS своего сайта.(.*)index\.(php|html|htm)$ http://site.ru/$1 [R=301,L]

Если же сайт использует Nginx, то правила прописываются в файле nginx.conf. Для перенаправления также нужно прописывать правила с помощью регулярных выражений, например:

location = /index.html {

return 301 https://site.com

}

Вместо index.html можно указать любой другой URL-адрес страницы вашего сайта, с которого нужно сделать редирект.

На этом этапе важно следить за корректностью новой части кода: если в ней будут ошибки, исчезнут не только дубли, но и вообще весь сайт из всего интернета.

Создание канонической страницы

Использование canonical указывает поисковому пауку на ту единственную страницу, которая является оригинальной и должна быть в поисковой выдаче.

Чтобы выделить такую страницу, нужно на всех URL дублей прописать код с адресом оригинальной страницы:

<link rel= “canonical” href= «http://www.site.ru/original-page.html”>

Можно прописывать их вручную, но это займет много времени, поэтому есть смысл использовать плагины. Например, в WordPress это YoastSEO или AllinOneSEOPack.

В 1С-Битрикс это делается с помощью языка программирования PHP в соответствующих файлах. Такая же история и с CMS Joomla: без вмешательства программиста или собственных навыков программирования здесь не обойтись.

Директива Disallow в robots.txt

В файле robots.txt содержатся инструкции для поисковых краулеров, как именно индексировать сайт.

Читать по теме: Как правильно заполнить файл robots.txt: критически важные моменты

Если на сайте есть дубли, можно запретить краулеру их индексировать с помощью директивы:

User-agent: *

Disallow: site.ru/contacts.php?work=225&s=1

Такой способ практически не требует навыков программиста, однако он не подходит, если дублей много: очень много времени уйдет на изменение robots.txt каждого дубля».

Выбирайте способ, исходя из собственных навыков программирования и личных предпочтений, и не давайте поисковикам повод сомневаться в релевантности и качестве вашего сайта.

Поиск дублей страниц сайта: программы, сервисы, приёмы

От автора

О теории дублирования контента на сайте я писал стать тут, где доказывал, что дубли статей это плохо и с дубли страниц нужно выявлять и с ними нужно бороться. В этой статье я покажу, общие приемы по выявлению повторяющегося контента и акцентирую внимание на решение этой проблемы на WordPress и Joomla.

Еще немного теории

Я не поддерживаю мнение о том, что Яндекс дубли страниц воспринимает нормально, а Google выбрасывает дубли из индекса и за это может штрафовать сайт.

На сегодня я вижу, что Яндекс определяет дубли страниц и показывает их в Яндекс.Вебмастере на вкладке «Индексация». Более того, ту страницу, которую Яндекс считает дублем, он удаляет из индекса. Однако я вижу, что Яндекс примет за основную страницу первую, проиндексированную и вполне возможно, что этой страницей может быть дубль.

Также понятно и видно по выдаче, что Google выбрасывает из поиска НЕ все страницы с частичным повторением материала.

Вместе с этим, отсутствие дублей на сайте воспринимается поисковыми системами, как положительный фактор качества сайта и может влиять на позиции сайта в выдаче.

Теперь от теории к практике: как найти дубли страниц.

Поиск дублей страниц сайта

Перечисленные ниже способы поиск дублей страниц не борются с дублями, а помогают их найти в поиске. После их выявления, нужно принять меры по избавлению от них.

Программа XENU (полностью бесплатно)

Программа Xenu Link Sleuth (http://home.snafu.de/tilman/xenulink.html), работает независимо от онлайн сервисов, на всех сайтах, в том числе, на сайтах которые не проиндексированы поисковиками. Также с её помощью можно проверять сайты, у которых нет накопленной статистики в инструментах вебмастеров.

Поиск дублей осуществляется после сканирования сайта программой XENU по повторяющимся заголовкам и мета описаниям. Читать статью: Проверка неработающих, битых и исходящих ссылок сайта программой XENU

Программа Screaming Frog SEO Spider (частично бесплатна)

Адрес программы https://www.screamingfrog.co.uk/seo-spider/. Это программа работает также как XENU, но более красочно. Программа сканирует до 500 ссылок сайта бесплатно, более объемная проверка требует платной подписки. Статья: SEO анализ сайта программой Scrimimg Seo Spider

Программа Netpeak Spider (платная с триалом)

Сайт программы https://netpeaksoftware.com/spider. Еще один программный сканер для анализа ссылок сайта с подробным отчетом. Статья Программа для SEO анализа сайта Netpeak Spider

Яндекс.Вебмастер

Для поиска дублей можно использовать Яндекс.Вебмастер после набора статистики по сайту. В инструментах аккаунта на вкладке Индексирование >>>Страницы в поиске можно посмотреть «Исключенные страницы» и выяснить причину их удаления из индекса. Одна из причин удаления это дублирование контента. Вся информация доступна под каждым адресом страницы.

поиск дублей страниц в Яндекс.ВебмастерЯзык поисковых запросов

Используя язык поисковых запросов можно вывести список всех страниц сайта, которые есть в выдаче (оператор «site:» в Google) и поискать дубли «глазами». Как это сделать читать в статье Простые способы проверить индексацию страниц сайта.

Сервисы онлайн

Есть онлайн сервисы, который показывают дубли сайта. Например, сервис Siteliner.com (http://www.siteliner.com/) На нём можно найти битые ссылки и дубли. Можно проверить до 25000 страниц по подписке и 250 страниц бесплатно.

Российский сервис Saitreport.ru, может помочь в поиске дублей. Адрес сервиса: https://saitreport.ru/poisk-dublej-stranic

Google Search Console

В консоли веб-мастера Google тоже есть инструмент поиска дублей. Откройте свой сайт в консоли Гугл вебмастер. На вкладке Вид в поиске>>>Оптимизация HTML вы увидите, если есть, повторяющиеся заголовки и мета описания. Вероятнее всего это дубли (частичные или полные).

поиск дублей страниц в консоли веб-мастера GoogleЧто делать с дублями

Найденные дубли, нужно удалить с сайта, а также перенастроить CMS, чтобы дубли не появлялись, либо закрыть дубли от поисковых ботов мета-тегами noindex, либо добавить тег rel=canonical в заголовок каждого дубля.

Как бороться с дублями

Здесь совет простой, бороться с дублями нужно всеми доступными способами, но прежде всего, настройкой платформы (CMS) на которой строится сайт. Уникальных рецептов нет, но для Joomla и WordPress есть практичные советы.

Поиск и удаление дублей на CMS Joomla

CMS Joomla «плодит» дубли, «как крольчиха». Причина дублирования в возможностях многоуровневой вложенности материалов, размещения материалов разных пунктах меню, в различных макетах для пунктов меню, во встроенном инструменте пагинации (листания) и различной возможности сортировки материалов.

Например, одна и та же статья, может быть в блоге категории, в списке другого пункта меню, может быть, в сортировке по дате выпуска и вместе с тем, быть в сортировке по количеству просмотров, дате обновления, автору и т.д.

Встроенного инструмента борьбы с дублями нет и даже появление новой возможности «Маршрутизация URL» не избавляет от дублирования.

Решения проблемы

Решить проблему дублирования на сайтах Joomla помогут следующие расширения и приёмы.

Бесплатный плагин «StyleWare Content Canonical Plugin». Сайт плагина: https://styleware.eu/store/item/26-styleware-content-canonical-plugin. Плагин фиксирует канонические адреса избранных материалов, статей, категорий и переадресовывает все не канонические ссылки.

SEO Компоненты Joomla, Artio JoomSEF (бесплатный) и Sh504 (платный). У этих SEO «монстров» есть кнопка поиска и удаления дублей, а также есть легкая возможность добавить каноническую ссылку и/или закрыть страницы дублей от индексации.

Перечисленные расширения эффективно работают, если их ставят на новый сайт. Также нужно понимать, что при установке на рабочий сайт:

- На сайте со статьями в индексе эти расширения «убьют» почти весь индекс.

- Удаление дублей компонентами не автоматизировано и дубли всё равно попадают в индекс.

- Хотя управлять URL сайта этими компонентами очень просто.

Если дубль страницы попадет в индекс, то поисковики, не умея без указателей определять, какая страница является основной, могут дубль принять за основную страницу, а основную определить, как дубль. Из-за этого важно, не только бороться с дублями внутри сайта, но и подсказать поисковикам, что можно, а что нельзя индексировать. Сделать это можно в файле robots.txt, но тоже с оговорками.

Закрыть дубли в robots.txt

Поисковик Яндекс, воспринимает директиву Disallow как точное указание: материал не индексировать и вывести материал из индекса. То есть, закрыв на Joomla , страницы с таким url: /index.php?option=com_content&view=featured&Itemid=xxx, а закрыть это можно такой директивой:

Disallow: /*?

вы уберете, из индекса Яндекс все страницы со знаком вопроса в URL.

В отличие от Яндекс, поисковик Google не читает директиву Disallow так буквально. Он воспринимает директиву Disallow как запрет на сканирование, но НЕ запрет на индексирование. Поэтому применение директивы [Disallow: /*?] в блоке директив для Google файла robots.txt, на уже проиндексированном сайте, скорее приведет к негативным последствиям. Google перестанет сканировать закрытые страницы, и не будет обновлять по ним информацию.

Для команд боту Google нужно использовать мета теги <meta name=»robots» content=»noindex»/>, которые можно добавить во всех редакторах Joomla, на вкладке «Публикация».

Например, вы создаете на сайте два пункта меню для одной категории, один пункт меню в виде макета блог, другой в виде макета список. Чтобы не было дублей, закройте макет список мета-тегом noindex, nofollow, и это избавит от дублей в Google выдаче.

Также рекомендую на сайте Joomla закрыть в файле robots.txt страницы навигации и поиска от Яндекс на любой стадии индексации и от Google на новом сайте:

- Disallow: /*page*

- Disallow: /*search*

Стоит сильно подумать, об индексации меток, ссылок и пользователей, если они используются на сайте.

Поиск и удаление дублей на CMS WordPress

На WordPress создаваемый пост попадает на сайт как статья, и дублируется в архивах категории, архивах тегов, по дате, по автору. Чтобы избавиться от дублей на WordPress, разумно закрыть от индексации все архивы или, по крайней мере, архивы по дате и по автору.

Использовать для этих целей можно файл robots.txt с оговорками сделанными выше. Или лучше, установить SEO плагин, который, поможет в борьбе с дублями. Рекомендую плагины:

- Yast SEO (https://ru.wordpress.org/plugins/wordpress-seo/)

- All in One SEO Pack (https://ru.wordpress.org/plugins/all-in-one-seo-pack/)

В плагинах есть настройки закрывающие архивы от индексации и масса других SEO настроек, который избавят от рутинной работы по оптимизации WordPress.

Вывод

По практике скажу, что побороть дубли на WordPress можно, а вот с дублями на Joomla поиск дублей страниц требует постоянного контроля и взаимодействия с инструментами веб-мастеров, хотя бы Яндекс и Google.

©SeoJus.ru

Еще статьи

ПохожееКак найти и удалить дубли страниц на сайте?

Дубли страниц — документы, имеющие одинаковый контент, но доступные по разным адресам. Наличие таких страниц в индексе негативно сказывается на ранжировании сайта поисковыми системами.

Какой вред они могут нанести

- Снижение общей уникальности сайта.

- Затрудненное определение релевантности и веса страниц (поисковая система не может определить, какую страницу из дубликатов необходимо показывать по запросу).

- Зачастую дубли страниц имеют одинаковые мета-теги, что также негативно сказывается на ранжировании.

Как появляются дубликаты

Технические ошибки

К ним относят доступность страниц сайта:

- по www и без www;

- со слэшем на конце и без;

- с index.php и без него;

- доступность страницы при добавлении различных GET-параметров.

Особенности CMS

- страницы пагинации сайта;

- страницы сортировки, фильтрации и поиска товаров;

- передача лишних параметров в адресе страницы.

Важно! Также дубли страниц могут появляться за счет доступности первой страницы пагинации по двум адресам: http://site.ru/catalog/name/?PAGEN_1=1 и http://site.ru/catalog/name/.

Дубликаты, созданные вручную

Один из наиболее частых примеров дублирования страниц — привязка товаров к различным категориям и их доступность по двум адресам. Например: http://site.ru/catalog/velosiped/gorniy/stern-bike/ и http://site.ru/catalog/velosiped/stern-bike/.

Также страницы могут повторяться, если структура сайта изменилась, но старые страницы остались.

Поиск дублей страниц сайта

Существует большое количество методов нахождения дубликатов страниц на сайте. Ниже описаны наиболее популярные способы:

- программа Screaming Frog;

- программа Xenu;

- Google Webmaster: «Вид в поиске» -> «Оптимизация HTML»;

- Google Webmaster: «Сканирование» -> «Оптимизация HTML».

Для программы Screaming Frog и Xenu указывается адрес сайта, и после этого робот собирает информацию о нем. После того, как робот просканирует сайт, выбираем вкладку Page Title — Duplicate, и анализируем вручную список полученных страниц.

С помощью инструмента «Оптимизация HTML» можно выявить страницы с одинаковыми description и title. Для этого в панели Google Webmaster надо выбрать необходимый сайт, открыть раздел «Вид в поиске» и выбрать «Оптимизация HTML».

C помощью инструмента «Параметры URL» можно задать параметры, которые необходимо индексировать в адресах страниц.

Для этого надо выбрать параметр, кликнуть на ссылку «Изменить» и выбрать, какие URL, содержащие данный параметр, необходимо сканировать.

Также, найти все индексируемые дубли одной страницы можно с помощью запроса к поиску Яндекса. Для этого в поиске Яндекса необходимо ввести запрос вида site:domen.ru «фраза с анализируемой страницы», после чего проанализировать вручную все полученные результаты.

Как правильно удалить дубли

Чтобы сайт открывался лишь по одному адресу, например «http://www.site.ru/catalog/catalog-name/», а не по «http://site.ru/catalog/catalog-name/index.php», необходимо корректно настроить 301 редиректы в файле htaccess:

- со страниц без www, на www;

- со страниц без слэша на конце, на «/»;

- со страниц с index.php на страницы со слэшем.

Если вам необходимо удалить дубликаты, созданные из-за особенностей системы управления сайтом, надо правильно настроить файл robots.txt, скрыв от индексации страницы с различными GET-параметрами.

Для того чтобы удалить дублирующие страницы, созданные вручную, нужно проанализировать следующую информацию:

- их наличие в индексе;

- поисковый трафик;

- наличие внешних ссылок;

- наличие внутренних ссылок.

Если неприоритетный документ не находится в индексе, то его можно удалять с сайта.

Если же страницы находятся в поисковой базе, то необходимо оценить, сколько поискового трафика они дают, сколько внешних и внутренних ссылок на них проставлено. После этого остается выбрать наиболее полезную.

После этого необходимо настроить 301-редирект со старой страницы на актуальную и поправить внутренние ссылки на релевантные.

Поиск дублей страниц на сайте (Руководство от эксперта)

Добрый день, друзья! Уже очень давно меня просили читатели блога сделать пост о том, как избавиться от replytocom. Тема эта актуальна, так как из-за этого в индексе получается огромное число похожих страничек с параметрами коммента. Все дело в том, что многие блоги созданы на CMS WordPress, который грешит дубликацией комментариев. Поэтому я решил дать всю информацию не только о replytocom. В статье я раскрываю понятие дублированного контента, показываю как сделать поиск дублей страниц сайта и поясняю, почему от них нужно избавляться. А в следующем посте я покажу, как нужно их удалять.

Дублированный контент на сайте

Дубли бывают разными — тихими и заразными. 🙂 Если серьезно, то дублированная страница — это документ сайта, который может иметь полностью или частично одинаковый контент. Разумеется, каждый дубль имеет свой адрес (url страницы).

Есть четкие и нечеткие дубли. Четкий дубль страницы может возникнуть по следующим причинам:

- искусственно создаются владельцем сайта для специальных нужд. Например, страницы для печати, которые позволяют пользователю коммерческого сайта скопировать информацию по выбранному товару / услуге.

- генерируются движком ресурса, так как это у них заложено в теле. Некоторые современные CMS выдают похожие страницы с другими урлами, размещенные по своим разным дерикториям.

- появляются за счет ошибок веб-мастера, который управляет сайтом. Например, ресурс обзаводиться двумя одинаковыми главными страницами с разными адресами (например, site.ru и site.ru/index.php).

- возникают по случаю изменения структуры сайта. Например, при создании нового шаблона с другой системой урлов, новые страницы со старым контентом получают совершенно другие адреса.

Нечеткий дубль получают страницы, которые частично дублируют контент. Такие страницы имеют общую часть шаблона сайта, но отличаются небольшим контентным наполнением.

Например, такими небольшими дублями могут быть страницы ресурса, имеющие результаты поиска или отдельные элементы статьи (например, картинки — такое очень часто бывает во многих шаблонах блогов).

На следующем рисунке я собрал самые частые варианты дублей страниц, которые присущие блогу с движком Вордпресс (без учета различных плагинов и фишек шаблона, которые также частенько создают дублированные документы):

Наличие дублей страниц на сайте может говорить о том, что или веб-мастер не знает об их присутствии, или он просто не умеет с ними бороться. А бороться с ними нужно, так как они приводят к различным ошибкам и проблемам в плане поискового продвижения. Об этом сейчас и поговорим.

Почему нужно удалять дубли страниц

Дублированные страницы — это не какой-то вирусняк или паразитирующий организм. Он конечно тоже плодиться, но не за счет себя или своих функций. То есть он плодиться не по своей воле. Дубли на самом деле — это результат неправильного кода сайта, итог огрехов веб-мастера или блоггера.

Но какими бы не были пассивными дубли страниц, они могут подложить конкретную свинью владельцу любого сайта или блога. Итак, чем же так опасен дублированный контент? Вот основные проблемы, которые возникают при наличии дублей:

Ухудшение индексации сайта. Я называю это проблемой №1. Дело в том, что в зависимости от источника и ошибок веб-мастера, страница сайта может иметь от одного до нескольких или больше дублей. Например, главная может грешить двумя-тремя дупликатами, а посты блогов из-за вездесущего replytocom скопируются по количеству комментариев. И если блог популярный, то и число «левых» страниц будет огромным. А поисковые системы (особенно Google) не любят дубли и поэтому частенько занижают позиции самого сайта.

Замена релевантной страницы. Алгоритм поисковой системы может посчитать дубль более релевантным, чем продвигаемая страница-оригинал (моя статья о понятии релевантности). Тем самым в выдаче будет находиться не целевая страница, а ее клон. Но у этого клона совсем другие незначительные параметры (ссылочный вес, метрики посещаемости), которые со временем пессимизируют сайт в серпе поисковой системы.

Бесполезность естественных ссылок. Представьте себе картину — на Ваш сайт пришел посетитель. Ему понравился Ваш контент и он решился поделиться с друзьями полезным адресом понравившейся страницы. А эта страница — дубль оригинала. В итоге ссылку получит дублированный контент, а не наш реальный документ. Таким образом мы просто теряем настоящую естественную ссылку.

Итак, подытожим вышесказанное. Дубли страниц создают помеху в нормальной индексации сайта, становятся источником неправильного выбора поисковиком релевантной страницы, забирают влияние естественных внешних ссылок. Также дубли неправильно распределяют внутренний ссылочный вес, отбирая силу у продвигаемых страниц и меняя поведенческие показатели:

В общем, дубли — это большое зло в поисковом продвижении и страшный сон оптимизатора. 🙂

Как определить дубли страниц на сайте

Есть разные способы поиска и проверки дублей страниц. Они требуют разного уровня знаний CMS и понимание работы поискового индекса. Я покажу самый простой из способов. Это не значит, что если он простой, то не точный. С его помощью легко находятся дубликаты документов сайта. И самое главное — этот способ не требует особых знаний и не займет много времени.

Для того, чтобы найти и проверить свой сайт на наличие дубликатов страниц, нужно или воспользоваться расширенным поиском Яндекса (Гугла) или сразу ввести в поисковую строку специальный запрос. Сначала рассмотрим первый вариант.

Поиск дублей страниц с помощью расширенного поиска

Расширенный поиск Яндекса позволяет получить более точную выдачу благодаря уточняющим параметрам запроса. В нашем случае нам нужно только два параметра — адрес сайта и кусочек текста той страницы, по которой мы ищем дубли. Сначала мы выделяем текст, который находится на той странице нашего сайта (для примера взят абсолютно чужой ресурс), которую будем проверять на дубли. Затем идет в расширенный поиск Яндекса и вносим в соответствующие позиции кусочек контента и адрес сайта:

Далее мы нажимаем заветное слово «Найти» и русский поисковик начинает формировать выдачу. Она получится не той, которую мы обычно наблюдаем — она будет состоять полностью из заголовков и сниппетов только нашего ресурса. Причем, если в выдаче будет только один результат поиска, то все хорошо — дублированного контента этой страницы нет. Если же есть в полученном серпе несколько результатов, то придется доставать лопату:

В моем примере поисковик нашел несколько нечетких дублей — ряд страниц из пагинации по некоторым рубрикам. Сразу видно, что на данном сайте страница с выделенным текстом про рецепт салата явно размещалась сразу в разных рубриках. А так как запрет на индексацию страниц пагинации для этого ресурса не ставился, в индексе вылезли всевозможные дубли.

Теперь рассмотрим те же действия для зарубежного поисковика. Заходим на страницу расширенного поиска Google и совершаем те же самые действия:

Заполнив все необходимое на расширенном поиске, получаем индексацию исследуемого сайта согласно указанному куску текста:

Как видим, Гугл также проиндексировал неточные дубли исследуемой страницы — в выдаче все те же страницы рубрик.

В принципе получить те же самые результаты можно и не используя расширенный поиск. Для этого нужно в простом варианте Гугла или Яндекса прописать следующий запрос. И в этом заключается второй способ определения дублей документов.

Как найти дубли страниц с помощью специального запроса

С помощью расширенного поиска легко находятся все дубликаты по заданному тексту. Конечно, с помощью данного способа мы не получим дубли страниц, которые не содержат текст. Например, если дубль создается «кривым» шаблоном, который зачем-то показывает на другой странице картинку, которая находится на странице-оригинале. То такой дубликат выше описанным способом найти не получиться. В таком случае придется использовать другой способ.

Его суть проста — с помощью специального оператора мы запрашиваем индексацию всего нашего сайта (или отдельной страницы) и уже вручную смотрим выдачу в поисках дубликаторов. Вот правила синтаксиса этого запроса:

Когда мы в запросе указываем адрес главной страницы,то получаем просто список проиндексированных страниц поисковым роботом. Если же мы указывает адрес конкретной страницы, то получаем список проиндексированных дублей этой страницы. В Яндексе они сразу видны. А вот в Гугле все немного сложнее — сначала нам покажут те страницы, которые есть в основной выдаче:

Как видно на картинке, в основной выдаче у нас находится одна страница сайта и она же является оригиналом. Но в индексе есть и другие страницы, которые являются дублями. Чтобы их увидеть, нужно нажать на ссылку «Показать скрытые результаты»:

В итоге нам выдается список дублей, которые Гугл проиндексировал и связал со страницей-оригиналом (цифра 1 на картинке). В моем примере такими дублями стали страницы с позициями 2 и 3.

На второй позиции находится дубль, который является трекбэком данного документа (автоматическое уведомление для других сайтов данной публикации). Вещь конечно нужная, но ее присутствие в индексе не желательно. Хозяин данного сайта это прекрасно понимает и поэтому прописал запрет на индексацию трэкбеков с сайта. Об этом говорит надпись «Описание веб-страницы недоступно из-за ограничений в файле robots.txt». Если посмотреть инструкцию для поисковых систем (robots.txt), то увидим следующую картину:

Благодаря последним директивам, автор сайта указал на запрет индексации трэкбеков. Но к сожалению, Гугл заносит в свой индекс все, что ему попадется под руку. И здесь уже нужно просто удалять дубли из базы данных. об этом поговорим уже во второй статье, посвященной дублированному контенту.

На третьей позиции показан горячо любимый многими блоггерами replytocom. Он получается путем использования комментирования на блогах и сайтах. И благодаря ему возникает просто огромная куча дублей — обычно это количество примерно равно число комментов на ресурсе. В нашем примере этот атрибут, как и трэкбек закрыты для индексации. Но Гугл и его схавал в свой индекс. Тоже нужно чистить вручную.

Кстати, если мы немного изменим наш запрос, то можем получить те же результаты, что дает расширенный поиск дублей по кусочку текста:

Проверка дублей страниц с помощью Яндекс Вебмастера

Вариант проверки дублированного контента в вебмастере очень простой и состоит из следующих действий:

1Заходим в панель инструментов Яндекса в раздел меню «Индексирование» и открываем отчет «Страницы в поиске». В нем показывается статус проиндексированных страниц сайта в русском поисковике.На этой странице нас интересует кнопка «Исключенные страницы»:

2Нажав на эту кнопку, вебмастер показывает список документов, которые Яндекс исключил из поискового индекса (не путать с обычным индексом) и по каждой странице указывает причину удаления: 3В этом списке каждый столбец имеет свой фильтр. Нас интересует «Статус». Нажимаем его и получаем перечень всех вариантов, по которым Яндекс исключил данные документы:Если в этом списке есть вариант о дублировании страниц, выбираем его и получаем перечень документов-дублей. В моем примере такого варианта нет, но такие данные вебмастер может предоставить.

Вот фрагмент таблички с вариантами исключения страниц из поиска с исключением дублей:

Получив перечень страниц с дублированным контентом, остается только проверить эти страницы и выбрать вариант решения проблемы.

Как выявить дубли страниц с помощью seo-программ

Наряду со стандартными сервисами поисковых систем по оценке статуса сайта в поиске, существует множество различных источников с инструментарием по поиску дублей страниц на сайте.

Но также есть и ряд seo-программ, решающих проблему поиска дублированного контента. Принцип их работы практически одинаковый, что и у онлайн-сервисов, поэтому выбор может быть обусловлен по другим параметрам (скорость работы, стоимость продукта, дружелюбность интерфейса и т.д.).

Поэтому я не буду показывать подробно перечень действий каждого такого seo-инструмента, а просто дам следующий список самых популярных на мой взгляд программ:

Объемная seo-программа от фирмы Netpeak Software.

Плюсы: мощный функционал с рекомендациями использования по многим seo-вопросам. Большое сообщество пользователей программы

Минусы: платная (есть с 7-ми дневный триал)

Более современная версия бесплатного Xenu c обновлениями.

Плюсы: понятный интерфейс, хорошая скорость работы.

Минусы: Условно-бесплатная программа (проверка до 500 страниц без оплаты). Дубли только по заголовкам и описаниям.

Итак, друзья, в этой статье я приоткрыл занавес над понятием дублей страниц и их успешным нахождением и проверкой. Надеюсь, что мои способы поиска дублированного контента в вашей деятельности не понадобятся. Но если такое случится, адрес этого поста на всякий случай сохраните. 🙂

== Часто задаваемые вопросы по теме (FAQ) ==

Что такое дубли страниц на сайте?

Это документ сайта со своим уникальным адресом, который имеет полностью/ частично одинаковый контент, копируемый с исходной страницы.

Чем плохи и опасны ли дубли страниц для сайта?

Поисковой системе трудно выбрать из двух одинаковых страниц релевантную, чтобы показать ее в своей выдаче. Не тот документ может ухудшить видимость сайта в поиске.

Как найти дубли страниц на сайте?

С помощью расширенного поиска и оператора site в поисковых систем, соответствующими инструментами в сервисах по анализу сайта, путем использования специализированных программ.

Как удалить дубли страниц на сайте?

Использовать редирект 301, установить тег «rel=canonical» для страниц, запретить в файле robots.txt, корректировать вручную. Более подобно в этой практической инструкции.

С уважением, Ваш Максим Довженко

Дубликаты страниц сайта. Простой поиск дублей

Содержание:

Проверка сайта на дубликаты страниц

Ваш сайт продвигается слишком медленно? Постоянно случаются откаты на более низкие позиции? И это при том что внутренняя и внешняя оптимизация веб-ресурса выполнена на высшем уровне?

Подобное случается по нескольким причинам. Самая частая из них –дубликаты страниц на сайте, имеющих разные адреса и полное или частичное повторение содержания.

Чем опасны дубли страниц на сайте

Дубликаты страниц на сайте делают текст, размещенный на них неуникальным. К тому же снижается доверие к подобному веб-ресурсу со стороны поисковых систем.

Чем же еще опасны дубли страниц на сайте?

- Ухудшение индексации. Если веб-ресурс достаточно объемный и по каким-либо причинам регулярно происходит дублирование контента на сайте (бывают случаи, когда у каждой страницы существует по 4–6 дублей), это достаточно негативно влияет на индексацию поисковиками.

Во-первых, из-за того, что роботы поисковиков расходуют время при индексации лишних страничек.

Во-вторых, поисковики постоянно выполняют поиск дублей страниц. При обнаружения таковых они занижают позиции веб-ресурса и увеличивают интервалы между заходами своих роботов на его страницы.

- Ошибочное определение релевантной страницы. На сегодняшний день алгоритмы поисковых систем обучены распознавать дублирование контента на сайте, который индексируется. Но выбор поисковых роботов не всегда совпадает с мнением владельца веб-ресурса.

В итоге в результатах поиска может оказаться совсем не та страничка, продвижение которой планировалось. При этом внешняя ссылочная масса может быть настроена на одни странички, а в выдачу будут попадать дубликаты страниц на сайте.

В результате ссылочный профиль будет неэффективным и поведенческие факторы будут колебаться из-за распределения посетителей по ненужным страницам. Другими словами, будет путаница, которая крайне негативно скажется на рейтинге Вашего сайта.

- Потеря естественных ссылок. Посетитель, которому понравилась информация с Вашего веб-ресурса, может захотеть кому-нибудь ее рекомендовать. И если эту информацию он почерпнул на странице- дубликате, то и ссылку он будет распространять не ту, которая требуется.

Такие ценные и порой дорогие естественные ссылки будут ссылаться на дубли страниц на сайте, что в разы снижает эффективность продвижения.

Дублирование контента на сайте. Причины

Чаще всего дубли страниц на сайте создаются по одной из причин:

- Не указано главное зеркало сайта. То есть одна и та же страница доступна по разным URL — с www. и без.

- Автоматическая генерация движком веб-ресурса. Такое довольно часто происходит при использовании новых современных движков. Поскольку у них в теле заложены некоторые правила, которые делают дубликаты страниц на сайте и размещают их под другими адресами в своих директориях.

- Случайные ошибки веб-мастера, вследствие которых происходит дублирование контента на сайте. Результатом таких ошибок часто становится появление нескольких главных страничек, имеющих разные адреса.

- Изменение структуры сайта, которое влечет за собой присваивание новых адресов старым страницам. При этом сохраняются их копии со старыми адресами.

Как найти дубликаты страниц

Проверить сайт на дубли страниц поможет один из несложных методов:

- Анализ данных в сервисах поисковых систем для вебмастеров. Добавляя свой веб-ресурс в сервис Google Webmaster, Вы получаете доступ к данным раздела «Оптимизация HTML». В нем по дублируемым мета-данным можно найти страницы, на которых есть дублирование контента.

В Яндекс.Вебмастере дубли страниц можно проверить в разделе «Индексирование» > «Вид в поиске». На этой странице сделайте сортировку «Исключенные страницы» > «Дубли».

- Анализ проиндексированных страниц. Для получения их списка используется специальные операторы поисковых систем:

Полученная в результате выдача поможет проверить сайт на дубли страниц, у которых будут повторяться заголовки и сниппеты.

3. Поиск дублей фрагментов текста. Для получения их списка используются уже знакомые операторы (site: — для Google и hosh: — для Яндекса) , после которых указываем адрес сайта и в кавычках фрагмент текста. В результате мы можем получить либо полные дубли страниц, либо же частичное дублирование контента.

4. С помощью специальных программ и сервисов. Например, воспользовавшись программой Netpeak Spider, можно определить дубликаты страниц, текста, мета-тегов и заголовков. Все обнаруженные дубли необходимо будет удалить.

Если вы не хотите покупать десктопную программу Netpeak Spider, найти дубли страниц поможет многофункциональная seo-платформа Serpstat, которая работает онлайн + есть мобильная версия.

Сервис находит дублирующиеся тайтлы, дескрипшны, h2 дубль тайтла, больше чем 1 тайтл на странице, больше чем 1 заголовок h2 на странице.

ВыводыЖелательно время от времени выполнять вышеперечисленные проверки, чтобы дублирование контента на сайте не стало неожиданной причиной падения его рейтингов. При этом нужно не забывать, что полные дубликаты страниц не являются единственной проблемой.

Дублирующиеся h2, title, description, а также некоторые части контента вроде отзывов и комментариев также очень нежелательны.

Надеемся, что эта статья была для Вас полезной. Не забудьте поделиться ссылкой на нее с теми, кому она также может быть интересной!

Как найти дубликаты страниц на сайте

Довольно часто многие веб мастера задаются вопросом про то, как найти дубликаты страниц на сайте. Ведь поисковые системы как Google, Яндекс и Bing жестко реагируют на дубликаты контента, и могут понизить сайт в результатах поиска.

Поисковая система Google в 2011 году выпустила алгоритм Google Panda, который отвечает за контент на сайте, и в случае если сайт попадет под этот фильтр, то он может сильно потерять поисковый трафик на сайт.

Для начала читаем статью: внутренняя оптимизация сайта

В ней описаны основные моменты, которые стоит оптимизировать при продвижении сайта, в том числе и обратить внимание на дублирующийся контент на сайте.

На дубликаты страниц больше реагирует Гугл, для Яндекса это важно, но не критично.

Дубликаты страниц могут быть полными и не полными:

Полный дубль страницы – это страницы на сайте или блоге, которые содержат полностью одинаковый контент, но имеют различные адрес страниц (URL).

Не полный дубликат страницы – это страницы на сайте или блоге, которые содержат много одинакового контента, но они не полностью одинаковые, а так же имею отдельные адреса страниц.

Методы поиска дублей страниц

1. Google Webmaster Tools

Заходим в Google Webmaster Tools, дальше раздел оптимизация, и нажимаем на оптимизация HTML.

Мы сможем увидеть количество повторяющихся мета описаний на сайте, а так же title (тег который очень важный при продвижении).

Дальше нажимаем на повторяющиеся страницы, смотрим, что и как, и прописываем уникальные title на них.

Как мы видим на картинке, одинаковые title у страницы услуги по аналитике, и раздела на блоге про аналитику.

2. Поисковая строка в Google

С помощью поисковой строки можно посмотреть дубли страниц, для этого необходимо использовать следующую команду:

site:moisait.com -site:moisait.com/&

В таком случае:

site:moisait.com – показывает общего индекса в Google

site:moisait.com/&- показывает страницы основного индекса в Google

С помощью данной команды можно определить частичные дубли, а так же малоинформативные страницы, которые могут мешать основным страницам, ранжироваться лучше в поиске.

Для примера смотрим такое:

Так же в Google можно использовать фрагмент текста, например:

Фрагмент может быть из пару переложений и более, или пару ключевых слов как в примере.

3. Расширенный поиск в Яндексе

В Яндексе можно использовать расширенный поиск, и искать дубликаты страниц по заданному сайту, например:

Можно использовать нужные фрагменты текста или ключевые слова и находить дубликаты страницы.

4. Xenu

Это бесплатная программа для внутренней оптимизации и внутренней перелинковки.

Читаем статью: внутренняя перелинковка сайта

Программа сканирует все страницы и файлы на сайте, выдает битые ссылки, а так же дубликаты страниц, например:

Дубли страниц плохо влияют на seo продвижение сайта, их нужно выявить, устранить или закрыть.

Следующая статья про то, как убрать или закрыть дубликаты страниц на сайте.

Оцените статью

Загрузка…Поиск дублей страниц сайта | Как проверить онлайн и убрать дубли

Сколько раз делаю технический аудит какого-нибудь клиентского сайта, так обязательно нахожу дубли страниц. Это особенная проблема для больших интернет магазинов. Давайте сейчас разберемся, как эту проблему диагностировать и решить.

Дубли сайта — это страницы с идентичным или почти одинаковым контентом но разными URL.

Дублями могут быть мета-теги title и description, могут быть дубли текста или полного контента, то есть всего содержимого страницы. Наиболее часто дублями бывают страницы пагинации, карточки товаров, страницы фильтра или теги.

Причем частичное совпадение контента допустимо, например, в каких-то карточках товаров могут дублироваться характеристики или какие-то блоки на странице могут дублироваться, например, отзывы. Но если взять сайт в целом, то каждая страница на сайте должна быть уникальной.

От дублей страниц очень много бед для сайта. Например, они понижают общий рейтинг сайта, его общее качество в глазах поисковых систем. В google вообще можно словить фильтр Панду за большое количество дублей.

Например, яндекс идентифицирует дубли, они отображаются в яндекс вебмастере, он просто выплевывает их из выдачи.

А google наоборот их хранит и при достижении какого-то критического значения накладывает фильтр на сайт. В общем, вреда от дублей для сайта много и поэтому от них обязательно нужно избавляться.

Но для начала их нужно идентифицировать, и есть несколько способов поиска и проверки дублей страниц сайта онлайн, я разберу способы ручные и способы автоматизированные. Эти способы являются универсальными и подойдут для любого движка, будь то wordpress, битрикс, opencart, joomla и других.

Проверка дублей через яндекс вебмастер

Самый простой способ, если у вас есть яндекс вебмастер, вы можете зайти в раздел «Индексирование — страницы в поиске».

Выбрать здесь «Исключенные страницы» и посмотреть, нет ли у вас вот такой картины.

Вебмастер показывает, что это дубли, и если такое присутствует, то нужно от этого избавляться. Дальше я покажу, какие есть варианты исправить их.

Поиск через индекс поисковых систем

Следующий способ также ручной — нужно вбить в поисковую строку google такую комбинацию site:santerma.shop (после двоеточия адрес вашего сайта), и покажутся все страницы, которые есть в индексе поисковой системы.

Аналогично работает и в яндексе.

Затем вручную пройтись по сайту и посмотреть, какие есть проблемы. Например, вот видно, есть какие-то дубликаты заголовков — интернет магазин сантехники и водоподготовки САНТЕРМА.

Можно перейти и посмотреть, что это за дубликаты, заголовки у них одинаковые, получается страницы тоже могут быть одинаковые.

Это страницы пагинации, о чем я и говорил, что очень часто дублями является такие страницы. То есть сами страницы не являются дублями, но здесь дубли мета-теги, тайтл у всех этих страниц одинаковый.

Это означает, что вот таких страниц «Интернет магазин сантехники и водоподготовки» очень много, соответственно, эту проблему тоже нужно решать, для страниц пагинации делают rel canonical.

Как проверить дубли с помощью Screaming Frog

Следующий способ, как можно проверить онлайн и найти дубли страниц на сайте, уже является автоматическим, с помощью программы Screaming frog. Загружаем адрес сайта, нажимаем «Старт», и программа начинает парсить весь сайт.

Затем переходим в раздел Page title, нажимаем сортировку, и вот опять видно, что тайтлы полностью идентичные, причем разные url, а тайтлы везде одинаковые.

Это очень грубая ошибка, ее нужно исправлять, то есть тайтл для каждой страницы должен быть уникальным.

Как найти дубли сайта онлайн с помощью Saitreport

Еще один способ, как найти дубли сайта — через сервис Saitreport. Я записывал обзор по этому сервису, посмотрите видео:

Вкратце скажу, что дубли страниц можно найти во вкладке «Контент», спускаемся вниз и здесь вот есть «Полные дубликаты», «Почти дубликаты» и «Очень похожие».

Нас интересуют вот эти полные совпадения и почти дубликаты, особенно полные совпадения, переходим сюда и видим, что достаточно много дублей.

По URL видно, что эта страницы фильтров, две полностью идентичные страницы. Самое главное, чтобы фильтр был закрыт от индексации, чтобы весь этот мусор не попал в индекс. Если это просто находится на сайте, но не в индексе, то ничего страшного нет, но если этот мусор попадет в индекс, то можно легко похерить сайт.

Проверка дублей страниц index.php и index.html

И последний способ найти дубли — проверить файлы index.php и index.html, которые могут отвечать за отображение главной страницы сайта. Часто бывает, что на сайтах эти файлы настроены неправильно.

Чтобы это проверить нужно к адресу главной страницы через слэш прописать index.php. Если все настроено правильно, то должен произойти 301 редирект (сайт перебросит с index.php на главную страницу) или должна открыться страница 404 ошибки.

Но если по адресу site.ru/index.php открывается опять главная страница, то это является дублем, то есть страница site.ru/index.php дублирует главную страницу.

В этом случае нужно проверить внутренние страницы — также через слэш прописать index.php. Скорее всего опять откроются дубли внутренних страниц, иногда открывается опять главная, получаются многократные дубли через неправильную настройку этого файла.

Аналогично нужно проверить файл index.html. Как я сказал, должен произойти или 301 редирект (перебросить на главную страницу) или открыться страница 404 ошибки.

Как убрать дубли

Итак, что теперь делать с этими дублями, которые найдены? Вариантов много, и каждый вариант нужно выбирать в зависимости от ситуации, сайта, потому что один и тот же вариант может подойти одному сайту, но не подойдет другому.

Самое главное, нужно определить, насколько важны эти страницы для продвижения сайта. Есть ли на них трафик или может быть планируется, и дальше действовать в соответствии с этой важностью.

Если эта страницы не важны, то есть варианты:

- закрыть их от индексации;

- настроить на них canonical;

- совсем удалить их сайта.

Если же это страницы важные, то нужно их уникализировать:

- переписать метатеги;

- переписать заголовоки;

- переписать контент;

- сделать каждую страницу уникальный, чтобы она несла пользу посетителю и продвигалась в поиске.

Для закрепления материала, посмотрите более подробное и наглядное видео по поиску дублей:

Итак, я надеюсь, что статья была полезной для вас! Пишите ваши вопросы, комментарии, может что-то не понятно, просто пишите, если статья понравилась, я рад любой обратной связи. Поделитесь ею с друзьями в социальных сетях!

Сергей Моховиков

SEO специалист

Здравствуйте! Я специалист по продвижению сайтов в поисковых системах Яндекс и Google. Веду свой блог и канал на YouTube, где рассказываю самые эффективные технологии раскрутки сайтов, которые применяю сам в своей работе.

Вы можете заказать у меня следующие услуги:

Загрузка…Средство проверки дублированного содержимого / средство обнаружения плагиата

Средство проверки дублированного содержимого / обнаружение плагиата.

Обновления: 1. Средство проверки дублированного содержимого теперь также может обрабатывать ввод обычного текста, помимо ввода URL. 2. Щелкнув поле расширенных параметров, вы можете выбрать вариант поиска повторяющегося содержимого на основе нескольких точек данных (выделение текста). 3. И я изменил способ представления возвращаемых результатов.

Используйте средство проверки дублированного контента, чтобы найти внутренний и внешний дублированный контент для определенной веб-страницы.Дублированный контент — важная проблема SEO, потому что поисковые системы стараются отфильтровать как можно больше дубликатов, чтобы обеспечить лучший поиск. Этот инструмент может обнаруживать два типа (текстового) повторяющегося контента. Типы дублированного контента:

- Внутренний дублированный контент. Это означает, что один и тот же текст находится на нескольких страницах по одному и тому же URL-адресу.

- Внешний дублированный контент. В этом случае один и тот же текст находится на нескольких доменах.

Почему важно предотвращать дублирование контента?

Как упоминалось выше, поисковые системы не любят дублированный контент / плагиат, потому что пользователи не заинтересованы в просмотре страницы результатов поиска, содержащей несколько URL-адресов, каждая из которых содержит более или менее одинаковое содержание.Чтобы этого не произошло, поисковые системы пытаются определить исходный источник, чтобы показать этот URL-адрес для соответствующего поискового запроса и отфильтровать все дубликаты. Как мы знаем, поисковые системы неплохо справляются с фильтрацией дубликатов, но по-прежнему довольно сложно определить исходную веб-страницу. Может случиться так, что когда один и тот же блок текста появляется на нескольких веб-сайтах, алгоритм решит, что страница с наивысшим авторитетом / наивысшим доверием будет отображаться в результатах поиска, даже если это не исходный источник.В случае, если Google обнаруживает дублированный контент с целью манипулирования рейтингом или обмана пользователей, Google внесет корректировки в рейтинг ( Panda filter ) или сайт будет полностью удален из индекса Google и результатов поиска.

Как работает программа проверки дублированного контента?

- Найдите проиндексированный повторяющийся контент, используя ввод URL или ТЕКСТА.

- Используйте ввод URL для извлечения основного содержания статьи / текста, находящегося в теле веб-страницы. Элементы навигации удаляются, чтобы уменьшить шум (в противном случае многие страницы были бы ошибочно идентифицированы как внутренние дубликаты.)

- Используйте ввод текста, чтобы получить больше контроля над вводом.

- Выберите дополнительные параметры, чтобы выбрать одну или несколько точек данных, используемых для обнаружения повторяющихся страниц. Выбор нескольких точек данных даст вам более точные и даже лучшие результаты сопоставления. (Эти точки данных автоматически извлекаются из содержимого страницы или ввода текста).

- Подобный контент извлекается, возвращается и помечается как: входной URL, внутренний дубликат, внешний дубликат.

- Экспорт результатов в.CSV. и используйте электронную таблицу Excel / Open Office, чтобы просматривать, редактировать или сообщать о своих результатах.

Как использовать эти результаты?

Внутренние дубликаты В большинстве случаев вы начнете решать проблемы внутренних дубликатов. Потому что эти проблемы существуют в вашей собственной контролируемой среде (на вашем веб-сайте). Для удаления внутренних дубликатов можно использовать разные методы, в зависимости от характера проблемы. Некоторые примеры:

- Минимизировать повторение шаблонов

- Использовать постоянное перенаправление 301

- Использовать канонический тег

- Использовать обработку параметров в Инструментах Google для веб-мастеров

- Запретить индексирование URL.

Внешние дубликаты Внешние дубликаты — это отдельная история, потому что вы не можете просто внести изменения в свой собственный сайт и решить проблему. Некоторые примеры удаления внешних дубликатов:

- Обратитесь к веб-мастерам и попросите их удалить копии вашего контента.

- Если другой сайт дублирует ваш контент / в нарушение закона об авторских правах и обращение к нему не решает проблему, вы можете использовать эту форму, чтобы уведомить Google: https: // support.google.com/legal/troubleshooter/1114905.

Ограничения инструмента

- Этот инструмент автоматически извлекает текст из веб-страницы для использования в качестве входных данных для обнаружения дублированного контента. Это не всегда именно тот блок текста, который нужно проверять на наличие дубликатов. В этом случае лучше использовать текстовое поле для ввода.

- Новое содержимое необходимо проиндексировать, прежде чем его можно будет вернуть с помощью этого инструмента. Если странице / контенту менее 2 дней, шансы получить какие-либо результаты невелики.

- Не все дубликаты, найденные в Интернете, возвращаются этим инструментом. Но по сравнению с другими инструментами возвращает довольно большую сумму.

Внешние ресурсы:

Пожалуйста, поделитесь ❤ Инструменты для SEO, Инструменты для SEOКак проверить дублированный контент

Как найти повторяющееся содержимое

Следует свести к минимуму повторяющийся контент на веб-сайте, так как это может затруднить поисковым системам решение, какую версию ранжировать по запросу.

В то время как «штраф за дублирование контента» является мифом в SEO, очень похожий контент может вызвать неэффективность сканирования, снизить рейтинг PageRank и быть признаком того, что контент может быть объединен, удален или улучшен.

Следует помнить, что дублирующийся и похожий контент — естественная часть Интернета, что часто не является проблемой для поисковых систем, которые намеренно канонизируют URL-адреса и фильтруют их там, где это необходимо. Однако в масштабе это может быть более проблематично.

Предотвращение дублирования контента позволяет вам контролировать индексирование и ранжирование, а не оставлять это поисковым системам.Вы можете ограничить трату краулингового бюджета и объединить сигналы индексации и ссылок, чтобы помочь в ранжировании.

Из этого туториала Вы узнаете, как использовать Screaming Frog SEO Spider для поиска как точного дублированного контента, так и почти дублированного контента, где некоторый текст совпадает между страницами на веб-сайте.

Дублированный контент, обнаруженный любым инструментом, включая SEO Spider, необходимо анализировать в контексте. Посмотрите наше видео или продолжайте читать наше руководство ниже.

Для начала загрузите SEO Spider, который можно бесплатно сканировать до 500 URL.Первые 2 шага доступны только при наличии лицензии. Если вы бесплатный пользователь, перейдите к пункту 3 в руководстве.

1) Включите «Рядом с дубликатами» через «Конфигурация> Контент> Дубликаты»

По умолчанию SEO Spider автоматически определяет точные дубликаты страниц. Однако для определения «близких к дубликатам» необходимо включить конфигурацию, которая позволяет сохранять содержимое каждой страницы.

SEO Spider идентифицирует почти повторяющиеся элементы с совпадением сходства 90%, которое можно настроить для поиска контента с более низким порогом сходства.

SEO Spider также будет проверять только «индексируемые» страницы на наличие дубликатов (как на точные, так и на близкие).

Это означает, что если у вас есть два одинаковых URL, но один из них канонизирован для другого (и, следовательно, «неиндексируемый»), об этом не будет сообщаться — если этот параметр не отключен.

Если вы хотите найти проблемы с бюджетом сканирования, снимите флажок «Проверять только индексируемые страницы на наличие дубликатов», так как это поможет найти области, в которых могут возникнуть ненужные затраты.

2) Настройте «Content Area» для анализа с помощью «Config> Content> Area»

Вы можете настроить контент, который будет использоваться для анализа почти дублированных материалов. Для нового сканирования мы рекомендуем использовать настройку по умолчанию и уточнять ее позже, когда контент, используемый в анализе, можно будет увидеть и рассмотреть.

SEO Spider автоматически исключает элементы навигации и нижнего колонтитула, чтобы сосредоточиться на основном содержании. Однако не каждый веб-сайт построен с использованием этих элементов HTML5, поэтому при необходимости вы можете уточнить область содержания, используемую для анализа.Вы можете «включить» или «исключить» HTML-теги, классы и идентификаторы в анализе.

Например, на веб-сайте Screaming Frog есть мобильное меню вне элемента навигации, которое по умолчанию включено в анализ контента. Хотя это не такая уж большая проблема, в данном случае, чтобы сосредоточиться на основном тексте страницы, имя класса «mobile-menu__dropdown» можно ввести в поле «Исключить классы».

Это исключит включение меню в алгоритм анализа дублированного контента.Подробнее об этом позже.

3) Сканирование веб-сайта

Откройте SEO Spider, введите или скопируйте веб-сайт, который вы хотите сканировать, в поле «Введите URL-адрес в паук» и нажмите «Начать».

Подождите, пока сканирование не завершится и не достигнет 100%, но вы также можете просмотреть некоторые детали в режиме реального времени.

4) Просмотр дубликатов на вкладке «Содержание»

На вкладке «Контент» есть 2 фильтра, связанных с повторяющимся содержанием: «точные дубликаты» и «почти дублированные».

Только «точные дубликаты» доступны для просмотра в режиме реального времени во время сканирования.«Почти повторяющиеся» требуют вычисления в конце сканирования с помощью публикации «Анализ сканирования» для заполнения данными.

На правой панели «Обзор» отображается сообщение «(Требуется анализ сканирования)» напротив фильтров, которые требуют заполнения данных после анализа сканирования.

5) Нажмите «Анализ сканирования> Начать», чтобы заполнить фильтр «Почти повторяющиеся»

Для заполнения фильтра «Почти повторяющиеся», «Ближайшее совпадение по сходству» и «Нет. Столбцы рядом с дубликатами, вам просто нужно нажать кнопку в конце сканирования.

Однако, если вы ранее настроили «Анализ сканирования», вы можете дважды проверить в разделе «Анализ сканирования> Настроить» отметку «Почти повторяющиеся».

Вы также можете снять отметки с других элементов, которые также требуют анализа после обхода контента, чтобы ускорить этот шаг.

Когда анализ сканирования будет завершен, индикатор выполнения «анализа» будет на 100%, а в фильтрах больше не будет сообщения «(Требуется анализ сканирования)».

Теперь вы можете просмотреть заполненный почти повторяющийся фильтр и столбцы.

6) Просмотр вкладки «Контент» и фильтров «Точное» и «Рядом» дубликатов

После выполнения анализа после сканирования, фильтр «Почти повторяющиеся», «Ближайшее совпадение по сходству» и «Нет. Столбцы рядом с дубликатами будут заполнены. Только URL-адреса с содержанием, превышающим выбранный порог схожести, будут содержать данные, остальные останутся пустыми. В этом случае на сайте Screaming Frog их всего два.

Сканирование более крупного веб-сайта, такого как BBC, откроет гораздо больше.

Вы можете фильтровать по следующему параметру —

- Точные дубликаты — Этот фильтр будет показывать идентичные друг другу страницы с использованием алгоритма MD5, который вычисляет значение «хеш-функции» для каждой страницы и отображается в столбце «Хеш». Эта проверка выполняется в отношении полного HTML-кода страницы. Он покажет все страницы с совпадающими хэш-значениями, которые абсолютно одинаковы. Точные повторяющиеся страницы могут привести к разделению сигналов PageRank и непредсказуемости ранжирования.Должна существовать только одна каноническая версия URL-адреса, на которую имеется внутренняя ссылка. Другие версии не должны быть связаны, и они должны быть 301 перенаправлены на каноническую версию.

- Near Duplicates — этот фильтр будет показывать похожие страницы на основе настроенного порога сходства с использованием алгоритма minhash. Пороговое значение можно настроить в разделе «Конфигурация> Паук> Контент» и по умолчанию установлено значение 90%. В столбце «Самое близкое совпадение» отображается самый высокий процент сходства с другой страницей.Нет. В столбце «Рядом с дубликатами» отображается количество страниц, похожих на страницу, на основании порогового значения схожести. Алгоритм работает с текстом на странице, а не с полным HTML, как с точными дубликатами. Контент, используемый для этого анализа, можно настроить в «Конфигурация> Контент> Область». Страницы могут иметь стопроцентное сходство, но только «почти дубликат», а не точный дубликат. Это связано с тем, что точные дубликаты исключаются как близкие к дубликатам, чтобы они не помечались дважды.Оценки схожести также округляются, поэтому 99,5% или выше будут отображаться как 100%.

Почти повторяющиеся страницы следует проверять вручную, так как существует множество законных причин, по которым некоторые страницы могут быть очень похожими по содержанию, например, варианты продуктов, объем поиска которых определяется их конкретным атрибутом.

Тем не менее, URL-адреса, помеченные как почти повторяющиеся, должны быть проверены, чтобы решить, должны ли они существовать как отдельные страницы из-за их уникальной ценности для пользователя, или их следует удалить, объединить или улучшить, чтобы сделать контент более глубоким и уникальным. .

7) Просмотрите повторяющиеся URL-адреса с помощью вкладки «Повторяющиеся сведения»

Для «точных дубликатов» проще просто просмотреть их в верхнем окне с помощью фильтра, поскольку они сгруппированы вместе и имеют одно и то же значение «хеш-функции».

На приведенном выше снимке экрана каждый URL-адрес имеет соответствующий точный дубликат из-за версии с косой чертой в конце и без косой черты.

Для «почти повторяющихся» щелкните вкладку «Duplicate Details» внизу, которая заполняет нижнюю панель окна «почти повторяющимся адресом» и схожестью каждого обнаруженного почти повторяющегося URL-адреса.

Например, если для URL-адреса в верхнем окне обнаружено 4 почти дубликата, их все можно просмотреть.

В правой части вкладки «Повторяющиеся сведения» будут отображаться почти повторяющиеся данные, обнаруженные на страницах, и выделены различия между страницами, когда вы нажимаете на каждый «почти повторяющийся адрес».

Если на вкладке повторяющихся сведений есть дублированный контент, который вы не хотите участвовать в анализе дублированного контента, исключите или включите любые HTML-элементы, классы или идентификаторы (как выделено в пункте 2) и повторно запустите сканирование. анализ.

8) Массовый экспорт дубликатов

Как точные, так и почти повторяющиеся дубликаты можно экспортировать массово, используя экспорт «Групповой экспорт> Контент> Точные дубликаты» и «Почти дубликаты».

Последний совет! Уточните порог схожести и область содержимого и повторно запустите анализ сканирования

После сканирования вы можете настроить как порог схожести, близкого к дублированию, так и область контента, используемую для анализа почти дублированного контента.

Затем вы можете повторно запустить анализ сканирования снова, чтобы найти более или менее похожий контент — без повторного сканирования веб-сайта.

Как указывалось ранее, на веб-сайте Screaming Frog есть мобильное меню за пределами элемента навигации, которое по умолчанию включено в анализ содержимого. Мобильное меню можно увидеть в предварительном просмотре содержимого вкладки «повторяющиеся сведения».

Если исключить «mobile-menu__dropdown» в поле «Исключить классы» в разделе «Конфигурация> Контент> Область», мобильное меню будет удалено из предварительного просмотра контента и анализа почти дублирующихся элементов.

Это действительно может помочь при точной настройке идентификации почти дублированного содержимого в основных областях содержимого без необходимости повторного сканирования.

Сводка

В приведенном выше руководстве должно быть показано, как использовать SEO Spider в качестве средства проверки дублированного контента на вашем веб-сайте. Для получения наиболее точных результатов уточните область содержимого для анализа и настройте порог для разных групп страниц.

Пожалуйста, ознакомьтесь также с ответами на часто задаваемые вопросы о Screaming Frog SEO Spider и полным руководством пользователя для получения дополнительной информации об этом инструменте.

Если у вас есть дополнительные вопросы, отзывы или предложения по улучшению инструмента дублирования контента в SEO Spider, просто свяжитесь с нами через службу поддержки.

Как проверить дублированный контент: инструменты и советы

Вы, наверное, знаете, что ваш сайт всегда должен содержать оригинальный контент. Если ваш сайт содержит дублированный контент, это огромная ошибка, которая может нанести ущерб вашему рейтингу сайта и вашей репутации. Плагиат или выдача чужой работы за свою без разрешения недопустимы как в Интернете, так и в автономном режиме. Дублированный контент может привести к тому, что Google оштрафует вас, понизив рейтинг вашей страницы или полностью исключив вашу веб-страницу из результатов поиска.Это вообще противоречит цели публикации контента.

Еще одна возможность, которую вы должны учитывать, заключается в том, что другие могут дублировать контент на вашем сайте и пытаться использовать его без вашего разрешения. Эти недобросовестные маркетологи могут откровенно использовать контент, который вы создали на их веб-сайтах, даже не спрашивая вас и не сообщая вам об этом, и в конечном итоге они могут превзойти вас в рейтинге поисковых систем.

Как определяется повторяющийся контент?

Дублированный контент — это контент, который появляется более чем в одном месте в Интернете, то есть на разных веб-сайтах.Если вы публикуете свой собственный контент более чем в одном месте, у вас будет дублированный контент. Если вы копируете чужой контент на свой сайт или они публикуют ваш контент на своем сайте, это дублированный контент.

Поисковым системам может быть сложно определить, какой контент более релевантен запросу в поисковой системе, когда контент слишком похож. Цель поисковых систем — предоставить пользователям наилучшие возможные результаты при поиске определенного термина. Google и другие поисковые системы могут исключить дублирующийся контент из своих поисковых запросов.

Некоторые причины дублирования содержимого

Во многих случаях использование дублированного контента не является преднамеренным или преднамеренным. Google относится к дублированному контенту как к идентичным или «в значительной степени похожим» блокам текста внутри или между доменами. Примеры не вредоносного дублированного контента включают описания товаров в магазине и версии веб-страниц только для печати.

Умышленное дублирование контента — другое дело. Когда один и тот же контент используется в нескольких доменах в попытке увеличить трафик или манипулировать рейтингом в поисковых системах, это может расстраивать людей, которые пытаются искать информацию и в конечном итоге получают один и тот же контент в нескольких местах.Вот почему поисковые системы делают все возможное, чтобы воспрепятствовать этой практике.

Использование Google для проверки дублированного содержания

Один из быстрых способов проверить, может ли страница считаться дублирующейся, — это скопировать около десяти слов из начала предложения и затем вставить их с кавычками в Google. На самом деле это рекомендуемый Google способ проверки.

Если вы протестируете это для страницы на своем веб-сайте, вы ожидаете, что будет отображаться только ваша веб-страница и, в идеале, без других результатов.

Если другие веб-сайты отображаются не хуже вашего, Google намекает, что считает, что исходный источник — это результат, который он показывает первым. Если это не ваш веб-сайт, возможно, у вас проблема с дублированием контента.

Повторите этот процесс, протестировав несколько случайных коротких предложений текста с вашей веб-страницы в Google.

Бесплатные инструменты для проверки дублированного содержимого

Когда вы пишете свой контент, вы можете непреднамеренно сделать его слишком похожим на уже опубликованный контент.Всегда полезно дважды проверять все, что вы пишете, с помощью средств проверки на плагиат, чтобы убедиться, что ваш контент рассматривается как уникальный. Некоторые из этих инструментов доступны бесплатно.

Вот несколько хороших бесплатных инструментов, которые можно использовать для проверки дублированного контента:

Copyscape — этот инструмент может быстро сравнить написанное вами содержимое с уже опубликованным за считанные секунды. Инструмент сравнения выделит контент, который отображается как повторяющийся, и сообщит вам, какой процент вашего контента соответствует уже опубликованному контенту.

Plagspotter — этот инструмент может определять повторяющиеся страницы контента в Интернете. Это отличный инструмент для поиска плагиатов, укравших ваш контент. Это также позволяет вам еженедельно автоматически отслеживать свои URL-адреса для выявления дублирующегося контента.

Duplichecker — этот инструмент быстро проверяет оригинальность контента, который вы планируете разместить на своем сайте. Зарегистрированные пользователи могут выполнять до 50 поисков в день.

Siteliner — это отличный инструмент, который может проверять весь ваш сайт один раз в месяц на наличие дублированного контента.Он также может проверять неработающие ссылки и определять страницы, которые наиболее заметны для поисковых систем.

Smallseotools — доступны различные инструменты SEO, в том числе средство проверки на плагиат, которое идентифицирует фрагменты идентичного контента.

И если вы хотите копнуть глубже, эти ссылки также предлагают больше инструментов по доступной цене.

Премиум-инструменты для проверки на плагиат

Премиум-программы проверки на плагиат имеют возможность проверять дублированный контент с помощью передовых алгоритмов.Они дают вам уверенность в том, что ваша работа не будет приписана тому, кто ее не писал.

Премиум-инструменты плагиата обычно предлагают отчеты, которые могут подтвердить подлинность. Будущие выводы о том, что ваша работа не является оригинальной, могут противоречить этим отчетам, которые можно сохранить в формате PDF.

Примеры дополнительных инструментов для проверки дублированного контента:

Grammarly — их премиальный инструмент предлагает как средство проверки на плагиат, так и проверку грамматики, выбора слов и структуры предложения.

Plagium — предлагает бесплатный быстрый поиск или расширенный поиск.

Plagiarismcheck.org — обнаруживает точные совпадения и перефразированный текст.

Ваш контент был очищен?

Содержимое вашего веб-сайта должно быть полностью оригинальным, и указанные выше инструменты могут помочь вам убедиться, что вы случайно не сделали свой контент слишком похожим на контент, который появляется на чужом веб-сайте.

Другая причина постоянно проверять дублированный контент — это веб-сайты, которые намеренно крадут контент из чужого блога, чтобы использовать его самостоятельно.Обычно это делается с помощью автоматизированного программного обеспечения. Если у вас есть привычка проверять контент на своем собственном сайте, вы можете обнаружить, что часть его была очищена. Как ловить парсеры контента? Что делать, если вы обнаружите, что ваш контент дословно опубликован на чужом сайте?

Способы улова скреперов

Регулярное использование премиальных инструментов для борьбы с плагиатом может помочь вам найти контент, который вы написали на чужом сайте.Есть еще несколько способов отловить скопированный контент.

Обратные ссылки в WordPress могут отображаться в спаме, если вы используете Askimet. Если в вашем контенте всегда есть ссылки на некоторые из ваших постов, вы сможете найти парсеры контента таким образом.

Используйте инструменты для веб-мастеров и проверьте ссылки на свой сайт. Когда у вас есть большое количество ссылок с определенного сайта, вы можете обнаружить, что часть вашего контента была скопирована на их. Единственный способ быть уверенным — это посетить их сайт и проверить, какие страницы ссылаются на ваш сайт.Вы можете найти свой собственный контент на их сайте.

Используйте оповещения Google, чтобы получать уведомления, если какие-либо заголовки ваших сообщений появляются в Интернете после того, как ваш контент уже был опубликован.

Чем больше вы утверждаете себя в качестве авторитета в своей нише, тем больше вы можете обнаружить, что те, кто еще не утвердил свой собственный голос или авторитет, хотят позаимствовать ваш. Это позволяет им предоставлять авторитетную информацию в своем блоге, не прилагая усилий для создания качественного контента.

Что делать со скребками контента

Очистка контента неэтична. Как только вы обнаружите, что ваш контент был очищен, у вас есть несколько вариантов того, что вам следует делать.

Свяжитесь с владельцем веб-сайта, на котором опубликовано ваше содержание, и сообщите ему, что вы нашли его на его сайте. Владелец сайта может не знать, что на его сайт был добавлен украденный контент, поэтому дайте ему возможность сомневаться. Вы можете связаться с ними через их контактную форму или через любую из социальных сетей, в которых они участвуют.

Если это качественный сайт, дайте им возможность поддерживать контент в актуальном состоянии, указав вас как автора и ссылку на ваш сайт. Другой вариант — предложить написать исправленную статью в обмен на ссылку. Если это некачественный сайт, сообщите им, что вы хотите, чтобы ваш контент был немедленно удален.

Если нет очевидного способа связаться с владельцем веб-сайта, выполните поиск в Whois. Это, вероятно, позволит вам узнать, кто они, если только он не зарегистрирован в частном порядке. Если вы все еще не можете узнать, кто является владельцем сайта, вы сможете узнать, кто его размещает, с помощью бесплатного инструмента Whoishostingthis.com. Свяжитесь с хостинговой компанией и сообщите им, что владелец веб-сайта публикует контент, защищенный авторским правом. Компании, предоставляющие веб-хостинг, серьезно относятся к подобным жалобам и своевременно предлагают помощь.

Защита контента с помощью DMCA

Вы обладаете авторскими правами на любой исходный контент, который вы публикуете на своем сайте. Один из способов защитить себя — разместить на своем сайте значок DMCA. DMCA гласит, что они бесплатно удалят ваш контент, если ваш контент будет украден, пока он защищен одним из их значков.

DMCA помогает сдерживать воров и предлагает инструменты, которые помогут вам найти неавторизованные копии вашего контента на чужом сайте. Они быстро удалят плагиат, включая изображения и видео.

Заключительные мысли о дублированном контенте

Люди, которые выходят в Интернет за информацией, ожидают найти оригинальный и полезный контент, и это то, что они должны найти. По возможности следует избегать дублирования контента. Контент должен быть хорошо написан и уникален, чтобы читатели могли получить максимум удовольствия от работы в сети.

Связанные

Избегайте дублирования содержимого | Центр поиска Google | Разработчики Google

Дублированный контент обычно относится к основным блокам контента внутри или между доменами. которые либо полностью соответствуют другому контенту, либо в значительной степени похожи. В основном это не обманчивое происхождение. Примеры не вредоносного дублированного контента могут включать:

- Дискуссионные форумы, которые могут создавать как обычные, так и урезанные страницы, ориентированные на мобильные устройства

- Товары в интернет-магазине, которые отображаются или связаны по нескольким отдельным URL-адресам

- Версии веб-страниц только для печати

Если ваш сайт содержит несколько страниц с в основном идентичным содержанием, существует ряд способы указать предпочтительный URL для Google.(Это называется «канонизацией».) Больше информации о канонизация.

Однако в некоторых случаях контент намеренно дублируется между доменами в попытке манипулировать рейтингом в поисковых системах или получать больше трафика. Подобные обманчивые практики могут приводит к ухудшению пользовательского опыта, когда посетитель видит практически тот же контент повторяется в наборе результатов поиска.